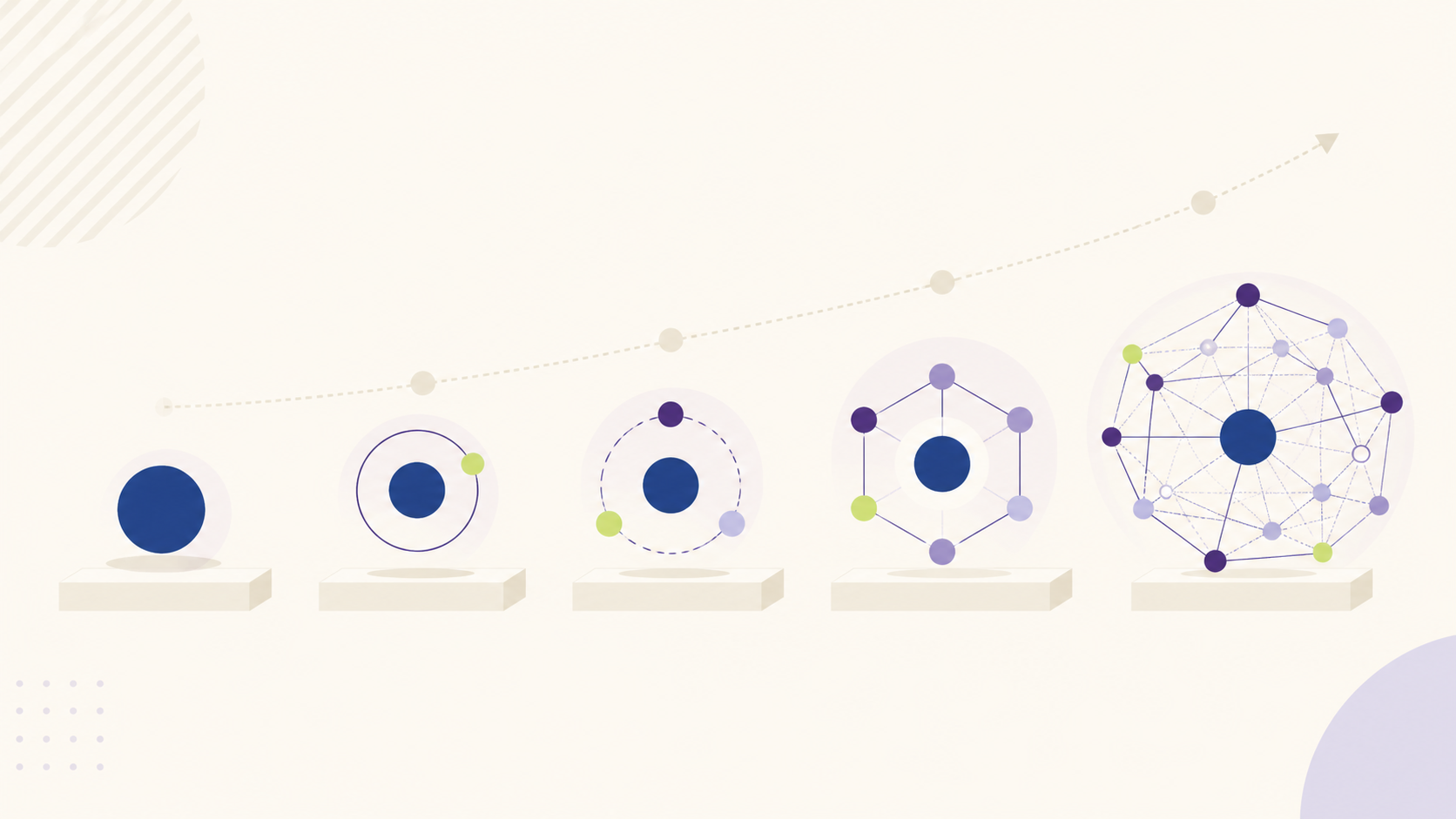

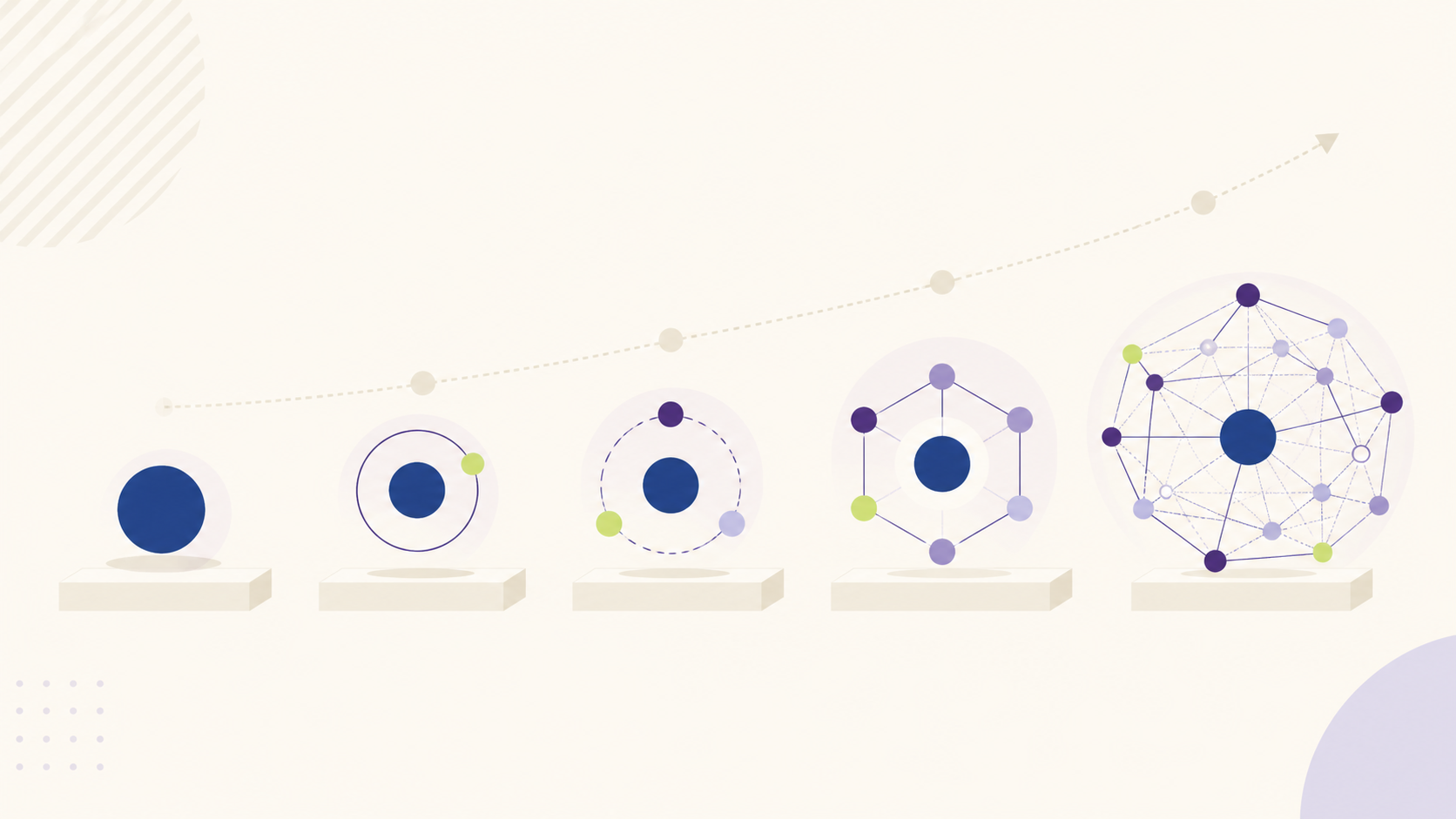

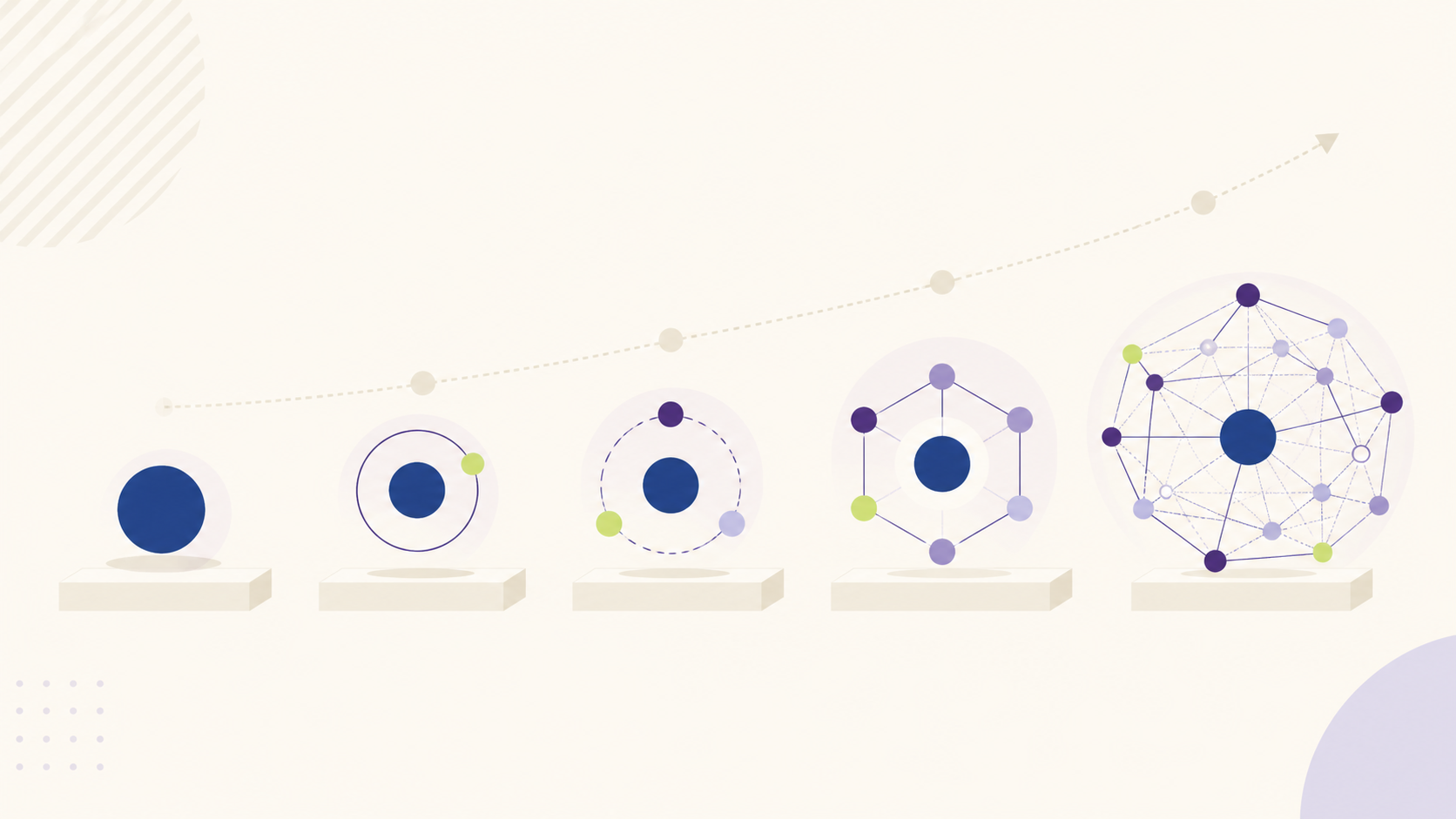

Tous les agents IA ne se ressemblent pas. Derrière ce terme générique se cache une typologie classique en cinq catégories — du plus simple au plus sophistiqué — qui structure aussi bien les manuels universitaires que les déploiements enterprise en 2026. Comprendre ces cinq types est essentiel pour choisir le bon niveau d’agent selon votre cas d’usage, éviter de surdimensionner inutilement vos projets et dialoguer correctement avec les éditeurs.

Cet article fait partie de notre guide complet sur les agents IA, qui pose les fondations du concept et de son écosystème.

En bref

- La classification standard distingue cinq types d’agents IA : réflexes simples, réflexes basés sur un modèle, basés sur des objectifs, basés sur l’utilité, et apprenants. Issue des travaux de Russell & Norvig, elle structure les architectures modernes en 2026.

- Comme le souligne Databricks, « les agents de production les plus performants sont des hybrides, combinant des réflexes pour la sécurité, une planification pour la flexibilité et un apprentissage limité pour l’adaptation ».

- Pour structurer cette compréhension dans vos équipes, Proactive Academy propose un parcours sur les agents IA en entreprise en intra et inter, éligible OPCO et CPF.

La typologie en cinq types provient des travaux fondateurs de Stuart Russell et Peter Norvig dans leur ouvrage de référence Artificial Intelligence: A Modern Approach, qui sert de manuel de base dans les cursus IA depuis trois décennies. Elle a été reprise et adaptée à l’IA agentique moderne par les éditeurs majeurs — IBM, Databricks, Google Cloud, Microsoft.

L’enjeu pratique est simple : chaque type correspond à un trade-off différent entre prévisibilité et adaptabilité. Un agent réflexe simple est ultra-prévisible mais inadaptable. Un agent apprenant s’adapte à tout mais reste imprévisible. Le bon choix d’architecture dépend de la nature du problème à résoudre — pas de la sophistication recherchée pour elle-même.

L’agent réflexe simple agit selon un principe « si A, alors B ». Il observe l’état actuel de son environnement, applique une règle prédéfinie, et exécute une action. Pas de mémoire, pas d’apprentissage, pas d’anticipation.

Comment il fonctionne : il s’appuie uniquement sur les informations environnementales actuelles et un ensemble de règles condition-action prédéfinies. Comme le décrit BrightData, « il ne conserve aucun état interne, aucune mémoire des expériences passées et ne tient pas compte des conséquences futures. Ses actions sont immédiates et réactives ».

Exemples typiques en 2026 : un thermostat connecté qui déclenche le chauffage en dessous de 18°C, un capteur IoT qui envoie une alerte au-delà d’un seuil, un chatbot FAQ basique qui mappe les questions aux réponses préprogrammées.

Limites : il fonctionne uniquement dans des environnements pleinement observables et stables. Le moindre changement de contexte qu’il ne sait pas catégoriser produit un comportement erratique ou nul.

Quand le choisir : pour des automatismes simples, à fort volume, où l’erreur a un coût faible et le contexte est très stable. Pour ces usages, l’IA agentique est souvent surdimensionnée — un script ou un workflow RPA suffit.

L’agent réflexe basé sur un modèle est une amélioration significative du précédent. Il maintient une représentation interne du monde — un « modèle » — qui suit l’état courant et tient compte des interactions passées pour décider.

Comment il fonctionne : comme le précise Brain Pod AI, « il maintient un état interne reflétant la condition actuelle du monde, lui permettant de prendre des décisions basées à la fois sur les entrées actuelles et les expériences passées ». Il fonctionne donc même dans des environnements partiellement observables.

Exemples typiques en 2026 : un système d’irrigation alimenté par l’IA qui surveille l’humidité du sol, les prévisions météo et les besoins des cultures pour optimiser les calendriers d’arrosage ; un robot navigateur qui évite les obstacles en se souvenant des positions précédentes ; un système de suivi de stocks qui anticipe les ruptures.

Cas réel documenté : selon Deloitte (2024) repris par Vooban, dans le secteur manufacturier, les agents IA de maintenance prédictive — qui suivent l’état des machines via un modèle interne et anticipent les besoins avant qu’une panne ne survienne — réduisent les coûts d’entretien de 25 à 30 % et prolongent la durée de vie des équipements.

Quand le choisir : pour des environnements partiellement observables où l’historique compte mais où les objectifs restent simples. C’est un excellent compromis fiabilité/adaptabilité pour de nombreux cas industriels.

L’agent basé sur des objectifs représente les résultats souhaités et évalue les actions possibles en fonction de leur capacité à rapprocher le système de ces objectifs. Plutôt que de réagir immédiatement, il planifie des séquences d’actions et s’ajuste à mesure que des obstacles apparaissent.

Comment il fonctionne : Databricks (2026) explique : « la planification permet la flexibilité et prend en charge un comportement plus complexe sur des horizons plus longs ». L’agent décompose un objectif en sous-tâches, choisit les outils, exécute, observe, ajuste — c’est exactement le pattern ReAct que nous avons décrit dans notre article sur le fonctionnement d’un agent IA.

Exemples typiques en 2026 : une application de navigation qui planifie l’itinéraire le plus rapide en fonction du trafic temps réel ; un agent SDR qui qualifie et contacte des prospects pour atteindre un quota mensuel ; une IA d’échecs qui évalue les coups en fonction de l’objectif final (gagner la partie).

Limites : la planification introduit aussi des coûts et de la fragilité. Les objectifs doivent être clairement définis, et les plans dépendent d’hypothèses sur le comportement de l’environnement. Un changement majeur peut faire dérailler tout le plan.

Quand le choisir : pour des cas d’usage avec un objectif clair, mesurable, et un environnement où la planification multi-étapes apporte une vraie valeur ajoutée. C’est le type dominant des agents enterprise modernes.

L’agent basé sur l’utilité va plus loin que l’agent orienté objectif : il ne cherche pas seulement à atteindre un but, mais à maximiser une fonction d’utilité qui mesure la satisfaction ou la valeur des résultats possibles. Il sait arbitrer entre plusieurs objectifs concurrents.

Comment il fonctionne : comme le décrit Brain Pod AI, « ces agents priorisent la maximisation des résultats dans un domaine spécifique en pondérant plusieurs facteurs pour déterminer le meilleur résultat possible ». L’utilité peut combiner coût, délai, qualité, satisfaction utilisateur, conformité — chaque facteur recevant un poids selon les priorités.

Exemples typiques en 2026 : une IA de tarification dynamique chez Uber ou Airbnb qui ajuste les prix en fonction de la demande, de la concurrence et de la marge cible ; un agent de gestion de portefeuille d’investissement qui arbitre entre rendement et risque ; un système de gestion de la chaîne d’approvisionnement qui optimise stock, délai et coût simultanément.

Quand le choisir : pour des cas d’usage où plusieurs objectifs s’opposent et où l’arbitrage est lui-même une décision complexe. C’est typique des contextes commerciaux, financiers et logistiques.

L’agent apprenant est le plus avancé de la classification standard. Il améliore ses performances au fil du temps en s’adaptant à de nouvelles expériences et données. Contrairement aux autres agents qui s’appuient sur des règles ou des modèles prédéfinis, comme le souligne IBM, « les agents apprenants mettent continuellement à jour leur comportement en fonction des informations fournies par l’environnement ».

Comment il fonctionne : il combine quatre composantes — un élément d’apprentissage qui améliore la performance, un élément de performance qui choisit les actions, un élément de critique qui évalue les résultats, et un générateur de problèmes qui suggère de nouvelles expériences à tester.

Exemples typiques en 2026 : les systèmes de recommandation Netflix ou Spotify qui affinent leurs suggestions au fil des interactions ; les détecteurs de fraude bancaire qui s’adaptent aux nouvelles techniques d’attaque ; les agents de trading algorithmique qui ajustent leurs stratégies selon les patterns de marché.

Cas réel documenté : selon DataCamp (décembre 2025), Klarna a déployé un agent multi-fonctions bâti sur LangChain (14 000 étoiles GitHub, 4,2 millions de téléchargements mensuels en 2026) qui a réduit le temps de résolution du service client de 80 % — résultat directement lié à la capacité d’apprentissage continu de l’agent à partir des cas traités.

Limites : les agents apprenants nécessitent une puissance de calcul importante et leur comportement devient difficile à prédire. La gouvernance est plus exigeante — un agent qui apprend des biais des données passées les amplifie.

Quand le choisir : pour des environnements très dynamiques où les patterns évoluent constamment et où l’amélioration continue produit une vraie valeur. À éviter quand la traçabilité et la prévisibilité priment.

Au-delà de la classification standard, l’évolution majeure de 2026 est l’émergence des systèmes multi-agents — non plus un agent unique, mais une équipe d’agents spécialisés qui coopèrent pour atteindre un objectif global.

Comme le décrit Polara Studio (avril 2026), « en 2026, nous ne construisons plus des agents isolés. La tendance lourde est aux systèmes multi-agents. Au lieu d’avoir un gros agent couteau suisse qui essaie de tout faire (et qui échoue souvent), nous créons des escouades d’agents spécialisés ».

Cas réel documenté chez L’Oréal : comme le rapporte Avisia (février 2026), le groupe a déployé une architecture multi-agents pour la rédaction de fiches produits. Un agent « PDP Writer » orchestre des échanges avec un agent « Brand DNA » (respect de l’image de marque), un agent « Amazon Knowledge » (optimisation SEO) et un agent « Legal » (conformité réglementaire locale). Chaque agent est spécialisé sur sa zone d’expertise, et l’orchestration produit un résultat final qu’aucun agent unique ne pourrait atteindre seul.

Ce pattern s’impose comme l’architecture de référence pour les déploiements enterprise complexes — sujet que nous traitons en profondeur dans notre article sur les systèmes multi-agents IA.

Databricks (2026) résume bien le principe : « les agents simples conviennent aux travaux stables et répétitifs, tandis que les environnements dynamiques peuvent nécessiter une planification ou un apprentissage, mais une autonomie accrue augmente souvent le risque et la complexité ».

Quatre questions guident le choix :

1. L’environnement est-il stable ou dynamique ? Stable → réflexe simple ou modèle. Dynamique → objectifs, utilité ou apprenant.

2. Y a-t-il un objectif unique ou plusieurs objectifs concurrents ? Unique → orienté objectif. Multiples → basé sur l’utilité.

3. Le système doit-il s’améliorer dans le temps ? Non → modèle ou objectif. Oui → apprenant.

4. La traçabilité prime-t-elle sur la performance ? Oui → réflexe ou modèle. Non → apprenant ou multi-agents.

Et l’observation pratique de Databricks reste valable : les agents de production les plus performants sont des hybrides — réflexes pour la sécurité, planification pour la flexibilité, apprentissage limité pour l’adaptation, le tout sous gouvernance claire.

Le piège le plus fréquent dans les projets d’agents IA est de viser trop haut. Beaucoup d’entreprises lancent des projets d’agents apprenants ou multi-agents alors qu’un simple agent basé sur un modèle aurait suffi — avec à la clé des coûts élevés, une gouvernance complexe, et un ROI décevant.

Trois compétences sont structurantes pour bien dimensionner ses projets :

Proactive Academy propose un programme de formation aux agents IA qui couvre ces trois dimensions, avec des ateliers pratiques sur le cadrage de cas d’usage par typologie. La formation est éligible OPCO et CPF.

La classification standard issue de Russell & Norvig en distingue cinq principaux : réflexe simple, réflexe basé sur un modèle, basé sur des objectifs, basé sur l’utilité, et apprenant. Certaines sources comme Botpress en ajoutent deux supplémentaires : agents hiérarchiques et systèmes multi-agents — qui sont plutôt des architectures combinant les cinq types fondamentaux.

ChatGPT en mode conversationnel classique est plutôt un assistant IA qu’un agent au sens strict. Quand il est utilisé via OpenAI Operator ou GPT Agents pour exécuter des tâches en autonomie, il opère typiquement comme un agent basé sur des objectifs combiné à des éléments d’apprentissage continu via la mémoire personnalisée. Notre article Agent IA vs assistant IA : 7 différences fondamentales détaille cette distinction.

Pour démarrer, le type 3 (orienté objectif) offre le meilleur rapport valeur/complexité. Il permet d’automatiser des workflows métier concrets (qualification de leads, tri d’emails, génération de rapports) sans la complexité d’un agent apprenant. Les plateformes no-code comme n8n ou Make sont parfaitement adaptées à ce type d’agent en 2026.

Pas mécaniquement, mais ils sont plus difficiles à classer. L’AI Act évalue le risque réel d’un système, pas son architecture technique. Un agent apprenant qui filtre des candidatures bascule en risque élevé (Annexe III), un agent apprenant qui optimise un parcours de livraison reste en risque limité. La traçabilité d’un agent apprenant étant moins évidente, il exige une instrumentation plus rigoureuse pour démontrer la conformité. Notre guide Agents IA, RGPD et AI Act détaille ces obligations.

L’agent unique reste pertinent pour les cas d’usage simples ou bien circonscrits. Le multi-agents devient nécessaire quand le problème implique plusieurs domaines d’expertise distincts (comme l’exemple L’Oréal avec brand, SEO, légal). Comme le rappelle l’agence Lewis (avril 2026), « la conception d’un système multi-agents n’est pas une affaire de code, c’est d’abord une affaire de cartographie métier ». Si vous ne savez pas cartographier les frontières entre agents, commencez par un agent unique bien cadré.

Comprendre la typologie des agents IA, c’est se donner un cadre rigoureux pour choisir l’architecture qui correspond vraiment à votre besoin — plutôt que de subir le marketing des éditeurs ou de courir après la sophistication. Le bon agent n’est pas le plus avancé, c’est celui qui résout votre problème avec le minimum de complexité requise. Pour structurer cette réflexion dans vos équipes, se former aux agents IA avec Proactive Academy reste le moyen le plus direct d’acquérir le cadrage, la méthode et les références sectorielles nécessaires.

Laisser un commentaire