Derrière la quasi-totalité des agents IA en production en 2026 — Claude Code, Cursor, agents LangChain, Aider, ChatGPT en mode tool use — se cache un même pattern architectural : ReAct, pour Reasoning + Acting. Introduit en 2022 par une équipe de Princeton et Google Research, ce framework structure la manière dont un agent alterne pensée et action pour résoudre un problème pas à pas. Cet article détaille la mécanique du pattern, montre une trace concrète d’exécution, et explique pourquoi maîtriser ce concept est devenu indispensable pour toute équipe qui déploie des agents IA.

Cet article fait partie de notre guide complet sur les agents IA, qui pose les fondations du concept et de son écosystème.

En bref

- ReAct est un pattern d’agent qui interleave pensée (Thought), action (Action) et observation (Observation) en boucle, jusqu’à atteindre l’objectif. Introduit en 2022 par Yao et al. (Princeton + Google), il est devenu le standard de fait en 2026.

- Sa force réside dans trois propriétés : interprétabilité (le raisonnement est explicite), récupération d’erreur (l’agent peut se corriger), et grounding (le raisonnement reste connecté aux observations réelles).

- Pour structurer cette compétence dans vos équipes, Proactive Academy propose un parcours formation Agents IA en intra et inter, éligible OPCO et CPF.

Le pattern ReAct a été introduit en octobre 2022 dans un article de recherche intitulé « ReAct: Synergizing Reasoning and Acting in Language Models », publié sur arXiv (2210.03629) par Shunyu Yao et ses collaborateurs de Princeton et Google Research, et présenté à ICLR 2023.

L’idée centrale est simple mais puissante. Avant ReAct, deux approches dominaient :

ReAct combine les deux. Comme le résume Sureprompts (avril 2026), « le modèle pense à ce qu’il doit faire, exécute une action (typiquement un appel d’outil), observe le résultat, puis raisonne à nouveau. Cette boucle se répète jusqu’à ce que la tâche soit terminée ».

Le papier original a démontré que ReAct dépassait les baselines purement Chain-of-Thought ou purement Acting sur des benchmarks de QA intensifs en connaissances (HotPotQA, Fever) — l’avantage venant largement de la capacité du modèle à se remettre d’un mauvais appel d’outil en raisonnant sur l’observation.

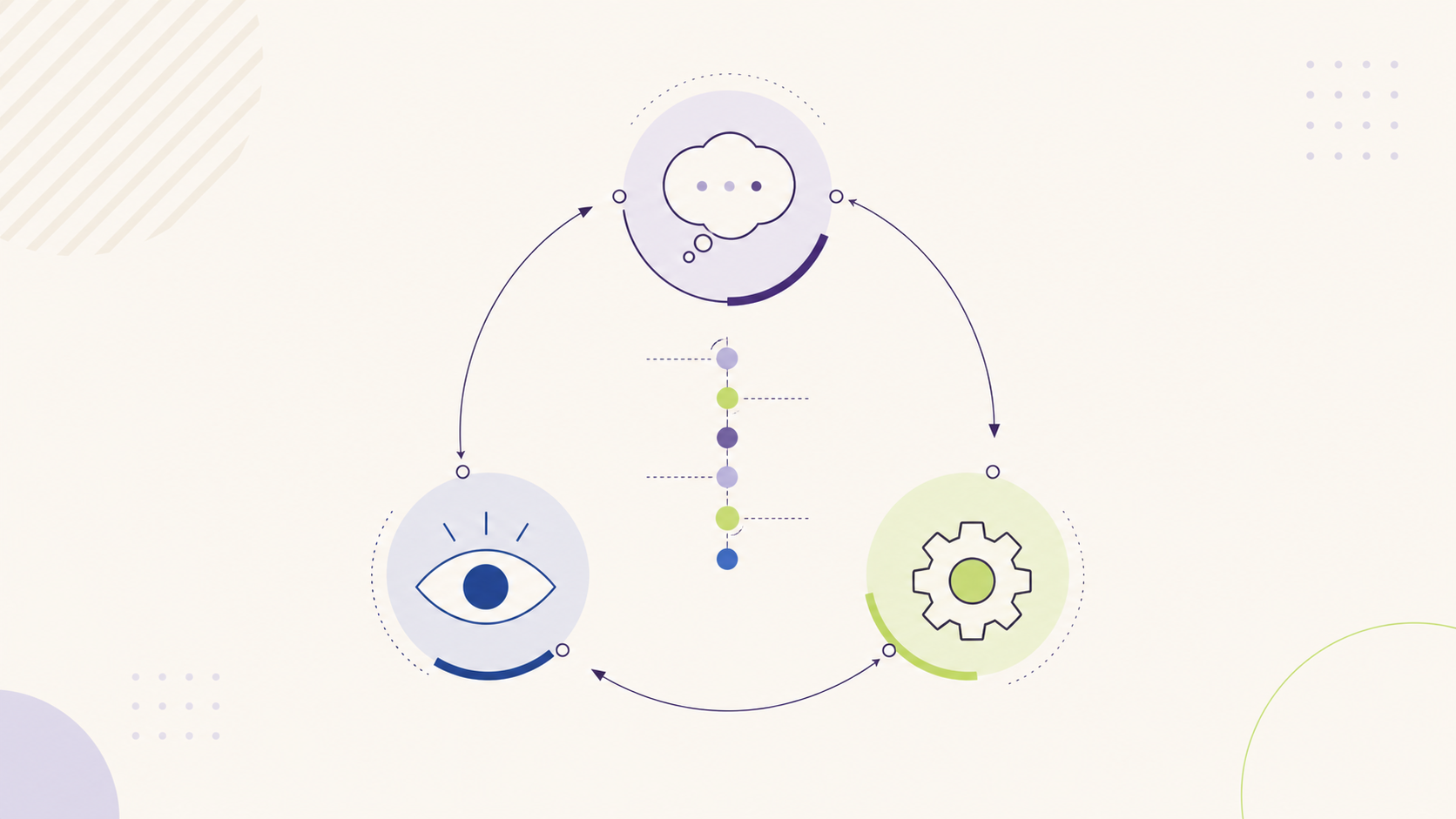

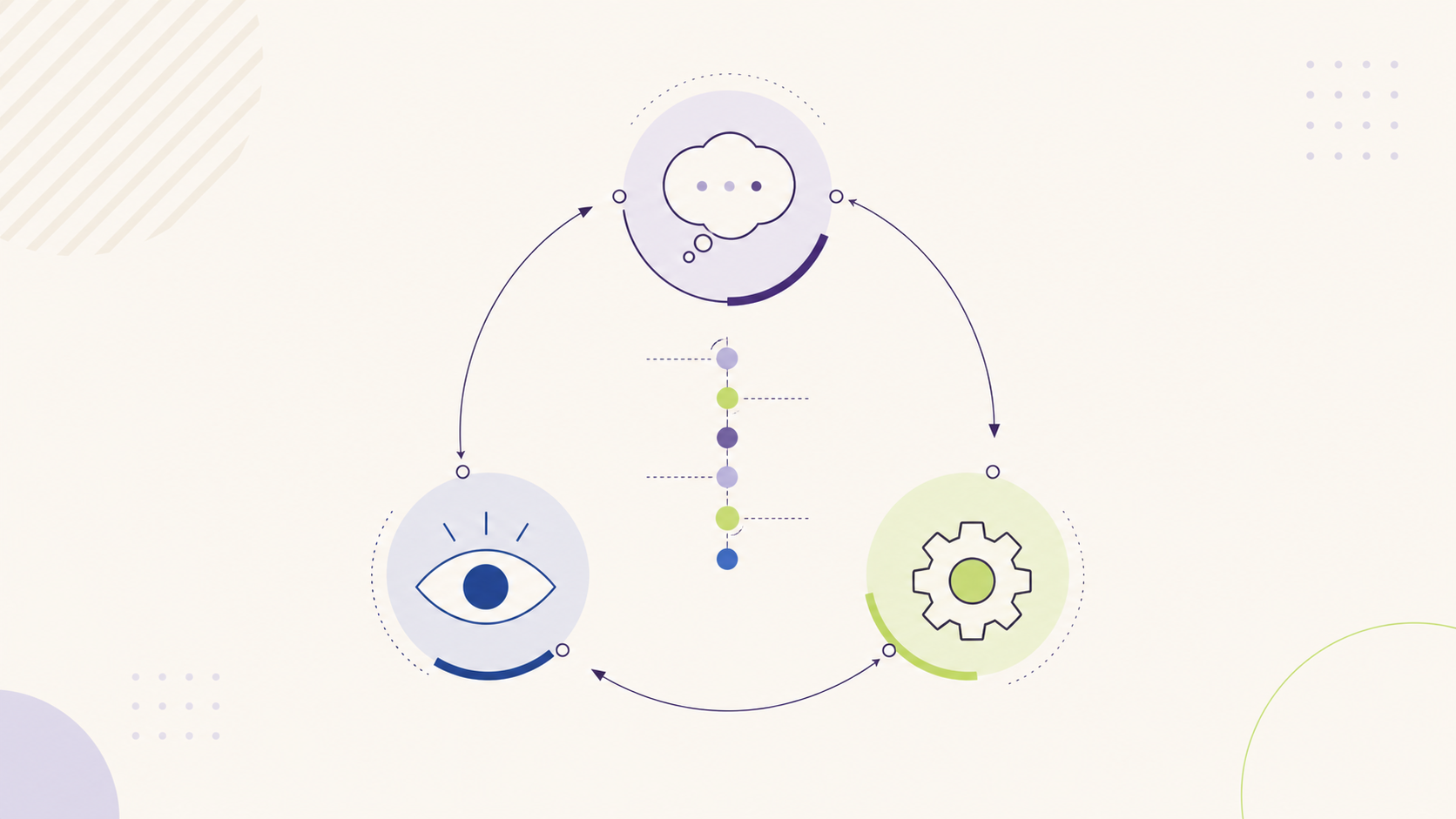

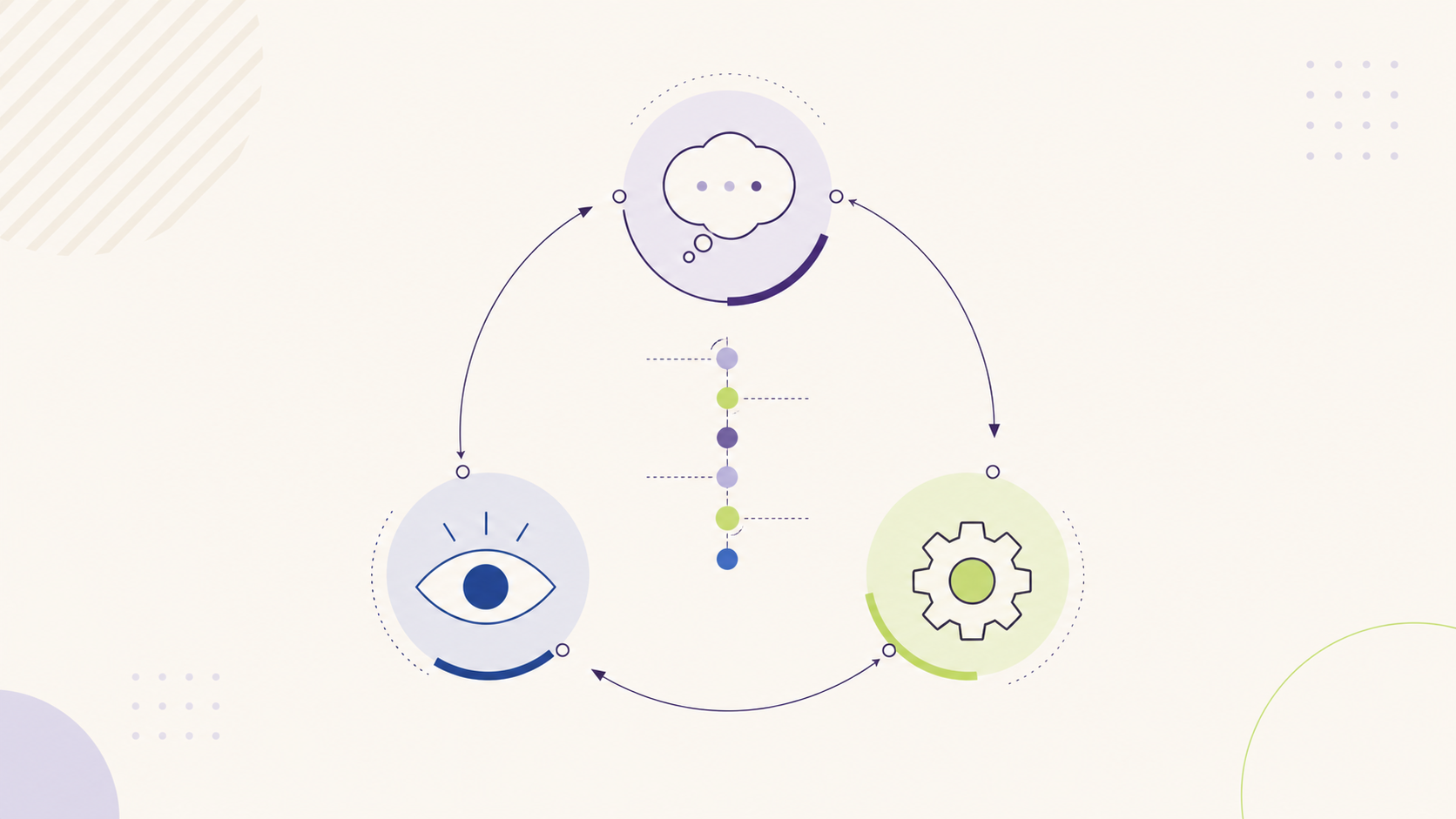

Une itération ReAct se déroule en trois étapes successives.

1. Thought (pensée) : le modèle raisonne sur l’état courant et décide quoi faire ensuite. Il verbalise sa stratégie : « la popularité varie dans le temps, je dois utiliser l’outil de recherche fourni ».

2. Action : le modèle exécute un appel d’outil — recherche web, lecture de fichier, requête en base, appel API. L’action est typiquement un function call structuré avec des paramètres.

3. Observation : l’outil renvoie un résultat. Cette observation devient la matière de la pensée suivante.

Chaque cycle réduit l’espace de recherche. Comme le souligne le Prompt Engineering Guide, « le modèle ne planifie pas tout le chemin à l’avance pour exécuter aveuglément — il raisonne une étape en avance, agit, regarde ce qui revient, et ajuste ».

Pour rendre la mécanique tangible, voici une trace réelle issue de la documentation officielle de LangChain (2026). L’objectif assigné à l’agent : « Trouve les casques sans fil les plus populaires en ce moment et vérifie s’ils sont en stock. »

Itération 1

Thought : « La popularité varie dans le temps, je dois utiliser l’outil de recherche fourni. »

Action :

search_products(query="wireless headphones")Observation : Found 5 products matching « wireless headphones ».

L’agent reçoit une liste de cinq produits. Il ne peut pas répondre tout de suite — il faut savoir lesquels sont vraiment populaires et vérifier leur disponibilité.

Itération 2

Thought : « J’ai cinq candidats, mais je dois identifier le plus populaire et vérifier le stock. Je vais commencer par regarder les évaluations utilisateurs et le volume de ventes du premier. »

Action :

get_product_details(product_id="prod_123")Observation : { « name »: « Sony WH-1000XM5 », « rating »: 4.7, « reviews »: 12500, « stock »: 47 }

L’agent obtient les détails du premier produit. Il pourrait en rester là, mais sa stratégie le pousse à vérifier les autres pour vraiment dire « le plus populaire ».

Itérations 3 à 5 : l’agent répète la séquence pour les quatre autres produits, accumulant les ratings, le nombre d’avis et les stocks dans son contexte.

Itération 6

Thought : « J’ai maintenant les données de tous les produits. Le Sony WH-1000XM5 a le meilleur rating (4,7) et le plus grand nombre d’avis (12 500), donc c’est le plus populaire. Il est en stock (47 unités). Je peux finaliser ma réponse. »

Action :

FINISHRéponse finale : « Le casque sans fil le plus populaire actuellement est le Sony WH-1000XM5 (4,7/5, 12 500 avis), disponible en stock (47 unités). »

Cette trace illustre les trois propriétés clés de ReAct : chaque pensée est explicite et auditable, chaque action a une justification rationnelle, et l’agent ajuste son plan à mesure que les observations arrivent. Si à l’itération 1 la recherche n’avait rien renvoyé, l’agent aurait pu décider de reformuler la requête ou de chercher dans une autre catégorie.

La documentation officielle Agent Patterns résume les quatre avantages structurels de ReAct.

Interprétabilité accrue : le raisonnement explicite rend les décisions transparentes. Pour des cas d’usage à enjeu — santé, finance, RH — pouvoir lire pas à pas pourquoi l’agent a pris telle décision est souvent une exigence légale.

Planification dynamique : l’agent ajuste sa stratégie en fonction des observations, contrairement à une approche « plan-then-execute » qui drafte tout le plan avant de l’exécuter aveuglément.

Réduction des hallucinations : en groundant le raisonnement dans des observations concrètes (résultats d’API, contenu de fichiers, données de bases), ReAct ancre le LLM dans la réalité plutôt que dans ses propres inventions.

Récupération d’erreur : si une action échoue ou produit un résultat inattendu, l’observation suivante permet à l’agent de détecter le problème et de changer de stratégie.

Comme le confirme Taskade, « ReAct est devenu l’architecture d’agent par défaut dans tous les grands frameworks ». Selon LangChain (2026), tous les agents LangChain suivent par défaut le pattern ReAct.

Deux patterns alternatifs se partagent le terrain en 2026 : ReAct (interleavage pensée-action) et Plan-and-Execute (planification complète puis exécution). Le choix dépend du contexte.

Choisissez ReAct quand : l’environnement est dynamique et les observations changent la stratégie ; les tâches nécessitent une exploration progressive ; vous avez besoin d’une traçabilité fine pour le debugging ou la conformité ; les modèles sous-jacents (Claude, GPT) ont des bons taux de réussite sur le function calling.

Choisissez Plan-and-Execute quand : la séquence d’actions est largement prévisible à l’avance ; la latence est critique (chaque cycle ReAct coûte un appel LLM supplémentaire) ; le coût en tokens doit être minimisé ; le déterminisme prime sur l’adaptabilité.

Comme le résume Taskade, « ReAct est plus adaptatif ; Plan-and-Execute est plus rapide et plus déterministe quand le plan est correct ». La plupart des architectures matures combinent les deux : un planificateur en amont, des nœuds ReAct pour les étapes nécessitant adaptation.

Le pattern ReAct n’est pas magique. Trois écueils reviennent dans les déploiements ratés.

Boucles infinies : si l’agent ne sait pas quand s’arrêter, il peut tourner en rond — chaque pensée appelle une nouvelle action sans converger. Sureprompts (avril 2026) recommande trois défenses : « un cap d’itérations dur dans le harness (stop après N étapes peu importe), un outil finish explicite que le modèle est instruit d’appeler quand il a terminé, et une condition d’arrêt liée à un état vérifiable (stop quand les tests passent, stop quand la réponse est en mémoire) ».

Sensibilité au prompt : comme le souligne Apxml, « la performance des agents ReAct est très sensible à la structure et à la formulation du prompt. Construire des prompts efficaces qui élicitent constamment le format Thought-Action voulu nécessite un design soigné et de l’expérimentation ».

Coût en tokens : chaque itération ReAct ajoute un appel LLM. Sur des tâches qui nécessitent 10-15 itérations, le coût grimpe vite. C’est pourquoi le routage multi-modèles est la pratique dominante en 2026 — utiliser un modèle Reasoning premium pour la planification stratégique et un modèle économique pour les sous-tâches répétitives, comme nous l’avons détaillé dans notre article sur le fonctionnement d’un agent IA.

Trois options dominent selon votre niveau technique.

Option 1 — No-code avec n8n ou Make : depuis fin 2025, n8n 2.0 propose des nœuds AI Agent natifs qui implémentent une boucle ReAct par défaut. Vous configurez le modèle (Claude, GPT, Mistral), vous attachez des outils via les 422+ intégrations disponibles, et vous laissez le pattern fonctionner. Pas de code à écrire.

Option 2 — Frameworks Python : LangChain et LangGraph proposent des agents ReAct prêts à l’emploi. Le template officiel langchain-ai/react-agent sur GitHub permet de démarrer en quelques lignes. CrewAI et AutoGen offrent des approches similaires avec des philosophies différentes (CrewAI privilégie les rôles spécialisés, AutoGen les conversations entre agents).

Option 3 — Implémentation manuelle : pour les cas qui exigent un contrôle fin, écrire la boucle ReAct soi-même reste pertinent. La boucle minimaliste tient en quelques dizaines de lignes : while iteration < max_iter: thought = llm.think(context); action = llm.decide_action(thought, tools); if action == "FINISH": return final_answer; observation = execute(action); context.append((thought, action, observation)).

Pour des architectures de production, l’observabilité est non négociable. LangSmith de LangChain capture chaque pensée, action et observation pour permettre le debugging à froid. Sans cette instrumentation, diagnostiquer pourquoi un agent a déraillé en production devient un cauchemar.

Comprendre le pattern ReAct ne suffit pas — il faut savoir le mettre en œuvre, le debugger, et l’optimiser. Trois compétences sont structurantes en 2026 :

Proactive Academy propose un programme de formation aux agents IA qui couvre ces trois dimensions, avec des ateliers pratiques sur LangChain et n8n. La formation est éligible OPCO et CPF, et inclut un module dédié au debugging d’agents ReAct en production.

Le Chain-of-Thought (Wei et al., 2022) fait raisonner le LLM à voix haute sans interaction avec l’extérieur — il pense mais n’agit pas. ReAct ajoute des actions concrètes (appels d’outils) et des observations entre chaque étape de raisonnement. ReAct est donc plus puissant pour les tâches qui nécessitent des informations externes ou une vérification empirique. Comme le précise IBM, ReAct combine Chain-of-Thought avec l’utilisation d’outils externes.

La grande majorité, oui. Selon Sureprompts (avril 2026), « la plupart des agents de coding en 2026 — Claude Code, Cursor, Aider — exécutent une boucle de style ReAct en interne ». Tous les agents par défaut de LangChain suivent ce pattern. C’est devenu le standard de fait, même si des variantes existent (Plan-and-Execute, ReWOO, Reflexion).

Cela dépend de la tâche. Pour des questions factuelles simples, 2 à 4 itérations suffisent. Pour des tâches multi-étapes complexes (recherche, analyse, rédaction), 8 à 15 itérations sont fréquentes. Selon Morph (février 2026), des agents spécialisés comme WarpGrep limitent à « 4 turns maximum » avec « 8 appels d’outils parallèles par turn » pour éviter l’explosion du contexte. Au-delà de 20 itérations sans convergence, il y a probablement un problème de cadrage ou de prompt.

Non. Les plateformes no-code comme n8n (gratuit en self-hosted), Make ou Zapier AI intègrent des nœuds AI Agent qui exécutent une boucle ReAct sous le capot. Vous décrivez l’objectif et les outils disponibles ; le pattern tourne automatiquement. Pour des architectures plus fines (multi-agents, mémoire avancée, debugging poussé), les frameworks Python comme LangChain offrent un contrôle complet — sujet que nous traitons dans notre article Comment créer un agent IA en entreprise.

L’interprétabilité native de ReAct (pensée explicite à chaque étape) en fait un atout pour les cas d’usage soumis à l’AI Act. Chaque décision est traçable, auditable, et explicable — ce qui répond aux exigences de transparence et de supervision humaine pour les systèmes à risque élevé (Annexe III). Mais cela ne dispense pas de mettre en place une gouvernance complète : journalisation, points de validation humaine, tests de biais. Notre guide Agents IA, RGPD et AI Act détaille ces obligations.

Le pattern ReAct n’est pas qu’une curiosité académique de 2022 — c’est l’épine dorsale invisible des agents IA que vous utilisez probablement déjà au quotidien. Comprendre ce qu’il fait, ce qu’il ne fait pas, et comment l’exploiter correctement vous donne une longueur d’avance sur les déploiements concurrents qui restent cantonnés au statut de PoC. Pour structurer cette compétence dans votre organisation, se former aux agents IA avec Proactive Academy reste le moyen le plus direct de passer de la curiosité technique à la maîtrise opérationnelle.

Laisser un commentaire