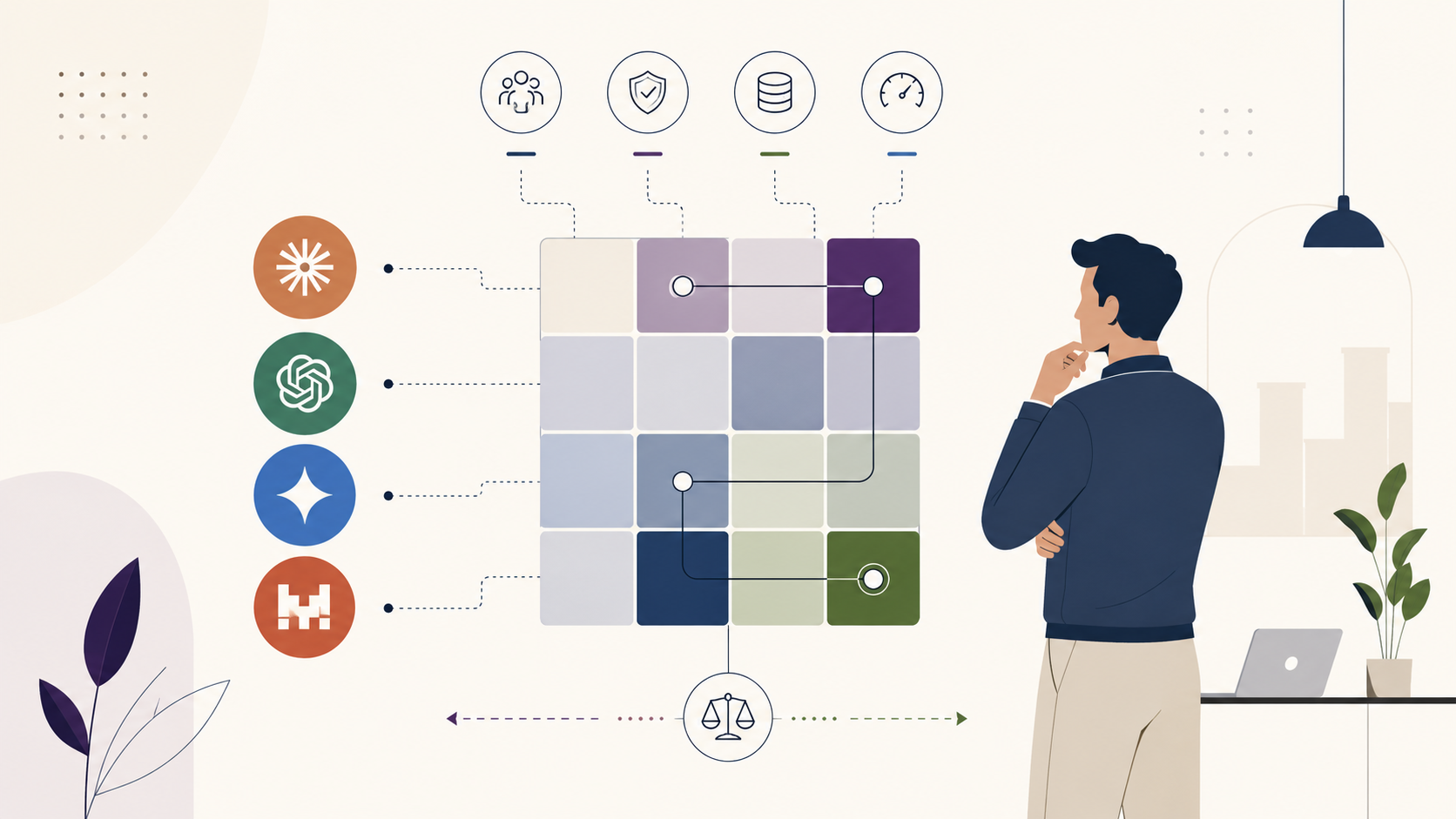

47% des projets d’agents IA dépassent leur budget LLM la première année selon les retours terrain consolidés. Pas parce que les modèles coûtent trop cher dans l’absolu, mais parce que le mauvais modèle a été choisi pour le mauvais cas d’usage. Le décideur PME qui démarre se trouve face à un paradoxe : trop de modèles disponibles, trop peu de critères clairs pour arbitrer. Cet article est conçu comme un outil de décision opérationnel pour répondre à la question concrète : « J’ai un cas d’usage X, mon budget est Y, mes contraintes sont Z, quel LLM je choisis ? » Pas un nouveau panorama (vous l’avez déjà dans notre pilier sur le choix d’un LLM pour vos agents IA), mais une matrice actionnable.

En 30 secondes : les 3 questions qui déterminent votre choix

- Quel volume de requêtes par jour ? (< 1 000 / 1 000-10 000 / > 10 000)

- Vos données sont-elles régulées ? (RGPD strict / HDS / SecNumCloud / aucune contrainte spéciale)

- Quel est votre budget mensuel cible ? (< 200 € / 200-1 000 € / > 1 000 €)

Ces 3 réponses orientent à 80% votre décision. Le reste, c’est l’optimisation.

Cette matrice synthétise les retours de déploiement de 2024-2026 sur les cas d’usage les plus fréquents en PME française. Elle vous donne un point de départ, pas une réponse définitive.

Ces 3 questions vous orientent à 80%. Détaillons chacune.

Si vous traitez :

Voir notre guide complet sur Mistral pour les agents IA en entreprise française pour le détail souveraineté.

Profil : 25 collaborateurs, 50-150 requêtes/jour, données clients ordinaires, budget 200-300 €/mois.

Choix recommandé : Claude Sonnet 4.6 via API ou Le Chat Pro pour 5-10 utilisateurs.

Pourquoi : Sonnet 4.6 produit la qualité éditoriale la plus naturelle en français parmi les modèles US. Excellent sur la créativité éditoriale, la voix, le ton. Volume faible justifie un seul modèle de qualité plutôt qu’une architecture multi-modèles complexe. Budget tient largement.

Coût mensuel estimé : 180-280 €/mois (API + abonnement Pro pour 5 utilisateurs intensifs).

Setup : 5-10 K€ initial (intégration plateformes de gestion de contenu, formation équipe, prompts de marque).

Profil : 40 collaborateurs, 200-500 requêtes/jour (analyse factures, contrats, relevés bancaires), données financières clients régulées, budget 400-800 €/mois.

Choix recommandé : Mistral Le Chat Enterprise avec connecteurs vers votre outil de gestion comptable.

Pourquoi : la régulation financière + RGPD strict imposent un fournisseur souverain. Mistral Le Chat Enterprise propose RGPD natif, hébergement UE, et connecteurs MCP vers les outils métier. Mistral Large 3 excelle sur les documents financiers en français.

Coût mensuel estimé : 350-700 €/mois (Le Chat Enterprise avec 10-15 sièges + connecteurs).

Setup : 15-25 K€ initial (intégration plateforme métier, formation équipe, configuration RGPD).

Profil : 35 collaborateurs, 2 000-5 000 requêtes/jour (chatbot + agent commercial), données B2B ordinaires, budget 500-1 500 €/mois.

Choix recommandé : architecture hybride 80/20 : Claude Haiku 4.5 ou GPT-5.5 Mini pour 80% du volume (FAQ, qualification tier 1) + Claude Sonnet 4.6 pour 20% (cas complexes, escalades).

Pourquoi : à ce volume, un modèle unique tier 1 coûte trop cher et un modèle unique tier 0 dégrade trop la qualité. L’architecture hybride routée par règles simples optimise le ratio qualité/coût. Selon Medium (février 2026), « le passage d’Opus à Sonnet uniquement sur les cas qui le justifient permet typiquement 40% d’économie pour une dégradation qualitative imperceptible ».

Coût mensuel estimé : 600-1 200 €/mois.

Setup : 20-35 K€ initial (architecture multi-modèles, routage intelligent, supervision, formation tech).

Profil : 15 collaborateurs, 100-300 requêtes/jour, données bénéficiaires sensibles (santé, social), budget contraint < 300 €/mois (financement marché public / OPCO).

Choix recommandé : Mistral Small 4 via Le Chat Pro (5-10 utilisateurs) ou Mistral self-hosted si l’infrastructure le permet.

Pourquoi : secteur médico-social = données sensibles + RGPD + HDS souhaitable. Budget contraint exclut le self-host coûteux d’entrée. Le Chat Pro à 14,99-18 €/mois par utilisateur reste accessible et propose la souveraineté française native. Mistral Small 4 est largement suffisant pour des cas d’usage d’aide et d’orientation.

Coût mensuel estimé : 100-200 €/mois (5-10 sièges Le Chat Pro).

Setup : 5-12 K€ initial (formation équipe accompagnement, configuration des cas d’usage, validation conformité). Financement OPCO ou CPF souvent possible.

C’est l’erreur structurante. Les benchmarks ne disent pas si un modèle est bon pour vous. Un Claude Opus 4.7 à 5/25 $ par 1M tokens est un investissement injustifié si votre cas d’usage est un chatbot FAQ à 200 requêtes/jour. Une PME qui veut un agent de qualification leads n’a pas besoin du modèle qui mène GPQA Diamond à 94,3%. Elle a besoin du modèle qui fait du tool calling fiable à un coût supportable.

Antidote : avant de choisir le modèle, listez 3-5 cas d’usage concrets avec volume, exigence de qualité, contraintes data. Le modèle se déduit du cas, pas l’inverse.

Selon Medium (février 2026), « la mauvaise décision modèle coûte 100 000 $+/mois. La bonne décision en économise 50 000 $+. Pourtant presque personne ne prend cette décision systématiquement. La plupart des équipes devinent ». Démarrer par Opus 4.7 par défaut « pour être tranquille » garantit le dépassement budgétaire dès les premiers mois.

Antidote : démarrez par le tier intermédiaire (Sonnet, GPT-5.5, Mistral Large) en validation. Si la qualité ne suffit pas pour 5-10% des cas, alors basculez vers le tier premium uniquement sur ces 5-10%. C’est la stratégie de routage.

Beaucoup de modèles facturent l’output 3 à 8 fois plus cher que l’input. Pour un agent qui génère beaucoup de texte (rédaction, résumés, analyses), le coût réel est dominé par l’output, pas l’input. Un modèle dont l’input semble bon marché peut coûter cher si son output est cher (ex : Gemini 3.1 Pro avec output 6x supérieur à l’input).

Antidote : calculez votre TCO sur un échantillon réel de 100 requêtes typiques avec vos prompts et outputs effectifs. Comparez 3-4 modèles sur votre ratio input/output réel, pas sur les prix d’entrée.

Au-delà de cette matrice générique, votre matrice spécifique doit intégrer vos contraintes propres. La démarche en 4 étapes :

Étape 1 : inventaire des cas d’usage. Listez 5-15 cas d’usage agents IA priorisés dans votre organisation, avec leur volume estimé, leur exigence de qualité, leurs contraintes data.

Étape 2 : grille des contraintes par cas. Pour chaque cas : RGPD ? HDS ? Souveraineté ? Latence critique ? Budget maximum ? Multilingue ?

Étape 3 : test sur échantillon. Sélectionnez 2-3 modèles candidats par cas. Testez sur 50-100 exemples réels de votre data. Mesurez qualité, coût, latence. Ne faites pas confiance aux benchmarks publics.

Étape 4 : décision et architecture. Validez le modèle par cas, et l’architecture multi-modèles si vos cas vont du simple au complexe. Documentez la matrice de décision pour les arbitrages futurs.

Ce processus demande typiquement 2 à 6 semaines en PME pour aboutir à une matrice opérationnelle et validée. C’est précisément le périmètre de notre parcours formation pour décideurs IT sur les agents IA, qui inclut la construction de votre matrice avec accompagnement.

Pour une PME de 20-50 personnes avec 2-3 cas d’usage agents IA, un seul modèle bien choisi suffit souvent. L’architecture multi-modèles devient pertinente à partir de 5-10 cas d’usage variés, ou à partir de 5 000-10 000 requêtes/jour quand l’arbitrage économique le justifie. Démarrer simple, complexifier seulement quand c’est nécessaire.

2 à 6 semaines en PME. Décomposé en : 1 semaine d’inventaire des cas et contraintes, 1-2 semaines de tests comparatifs sur vos data, 1-2 semaines de pilote sur un cas d’usage principal, 1 semaine de décision finale et formation. Plus rapide que 2 mois si vous avez une expertise interne. Plus long que 6 semaines si vous démarrez de zéro sans accompagnement.

Pour un POC sérieux : 5 000 à 15 000 € initial (formation, tests, intégration sur 1 cas d’usage). Pour un déploiement production sur 1-2 cas d’usage : 15 000 à 35 000 € initial + 200-800 €/mois en OpEx. Au-delà, on passe sur des projets ETI ou grand groupe avec des budgets différents.

Le marché LLM bouge tous les 2-3 mois (nouveaux modèles, prix qui baissent, capacités qui évoluent). Selon Iternal (mars 2026), « réévaluez vos sélections modèles trimestriellement et chaque fois qu’un nouveau modèle majeur sort ». En pratique pour une PME : audit modèles 2 fois par an, plus une veille active sur les annonces majeures qui pourraient changer l’arbitrage économique.

La matrice présentée couvre 80% des cas PME. Pour les cas plus spécifiques (par ex. : génération de code spécialisé, analyse vidéo, agents multilingues 10+ langues), faites un test comparatif rapide sur 3 modèles candidats avec 30-50 exemples réels de vos data. Le résultat factuel sur vos cas spécifiques tranche en 1-2 jours.

Pas systématiquement. Mistral est excellent dès que la souveraineté française ou RGPD strict est critique. Pour des cas d’usage classiques B2B sans contrainte data forte, Claude Sonnet 4.6 ou GPT-5.5 sont des choix tout aussi pertinents. Voir notre analyse approfondie de Mistral pour les agents IA. Une PME française rationnelle teste 2-3 modèles (dont Mistral) et choisit sur la base de données factuelles.

Trois options : (1) autonome avec ressources publiques, possible si vous avez un profil tech à l’aise avec l’évaluation de modèles, comptez 1-2 mois de travail interne ; (2) prestation consulting LLM, 8-25 K€ pour une étude complète, livrable matrice + recommandations ; (3) formation accompagnée, accompagner votre transformation par les agents IA avec un parcours qui transmet la méthode pendant que vous construisez votre propre matrice, financement Qualiopi / OPCO mobilisable.

La matrice de décision LLM pour vos agents IA est moins compliquée qu’elle n’en a l’air, à condition de partir de vos cas d’usage et vos contraintes plutôt que des benchmarks publics. Une PME de 20-50 personnes qui investit 2 à 6 semaines à structurer sa matrice initiale économise des dizaines de milliers d’euros sur 12-24 mois et évite les erreurs de surdimensionnement modèle qui caractérisent 40% des déploiements en 2026. Le piège n’est pas dans le choix d’un modèle particulier, c’est dans l’absence de méthode de choix. Cette matrice vous donne le point de départ, votre cas d’usage et votre budget vous donnent les contraintes, votre test sur 50-100 exemples réels vous donne la décision. Et si vous voulez aller plus vite avec une méthode éprouvée, notre formation pour décideurs IT sur les agents IA inclut la construction de votre matrice opérationnelle avec un accompagnement Qualiopi mobilisable sur votre plan de formation.

Laisser un commentaire